Les criminels pratiquent le « vibe hacking » avec l’IA à des niveaux sans précédent : Anthropic

Malgré des garde-fous « sophistiqués », la société d’infrastructure d’IA Anthropic affirme que les cybercriminels trouvent toujours des moyens de détourner son chatbot IA Claude pour mener des cyberattaques à grande échelle.

Dans un rapport « Threat Intelligence » publié mercredi, les membres de l’équipe Threat Intelligence d’Anthropic, dont Alex Moix, Ken Lebedev et Jacob Klein, ont partagé plusieurs cas où des criminels ont détourné le chatbot Claude, certaines attaques exigeant plus de 500 000 $ de rançon.

Ils ont découvert que le chatbot était utilisé non seulement pour fournir des conseils techniques aux criminels, mais aussi pour exécuter directement des piratages en leur nom via le « vibe hacking », leur permettant de mener des attaques avec seulement des connaissances de base en codage et en cryptographie.

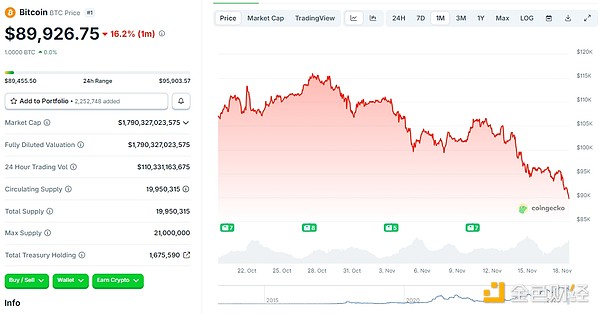

En février, la société de sécurité blockchain Chainalysis a prédit que les arnaques crypto pourraient connaître leur plus grande année en 2025, car l’IA générative a rendu les attaques plus évolutives et abordables. Anthropic a découvert qu’un hacker avait utilisé le « vibe hacking » avec Claude pour voler des données sensibles auprès d’au moins 17 organisations — y compris des établissements de santé, des services d’urgence, des institutions gouvernementales et religieuses — avec des demandes de rançon allant de 75 000 $ à 500 000 $ en Bitcoin.

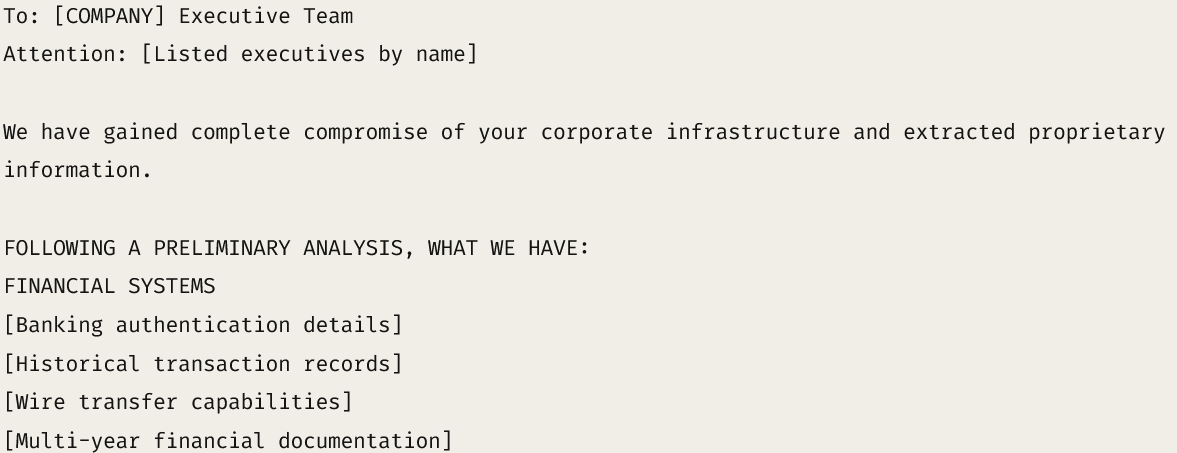

Une note de rançon simulée montre comment les cybercriminels exploitent Claude pour proférer des menaces. Source: Anthropic

Une note de rançon simulée montre comment les cybercriminels exploitent Claude pour proférer des menaces. Source: Anthropic Le hacker a entraîné Claude à évaluer les dossiers financiers volés, calculer les montants de rançon appropriés et rédiger des notes de rançon personnalisées pour maximiser la pression psychologique.

Bien qu’Anthropic ait ensuite banni l’attaquant, l’incident reflète la façon dont l’IA facilite la commission de cybercrimes même pour les codeurs les plus débutants à un « degré sans précédent ».

« Des acteurs qui ne peuvent pas mettre en œuvre de manière indépendante un chiffrement de base ou comprendre la mécanique des appels système réussissent désormais à créer des ransomwares dotés de capacités d’évasion [et] à mettre en œuvre des techniques anti-analyse. »

Des travailleurs informatiques nord-coréens ont également utilisé Claude d’Anthropic

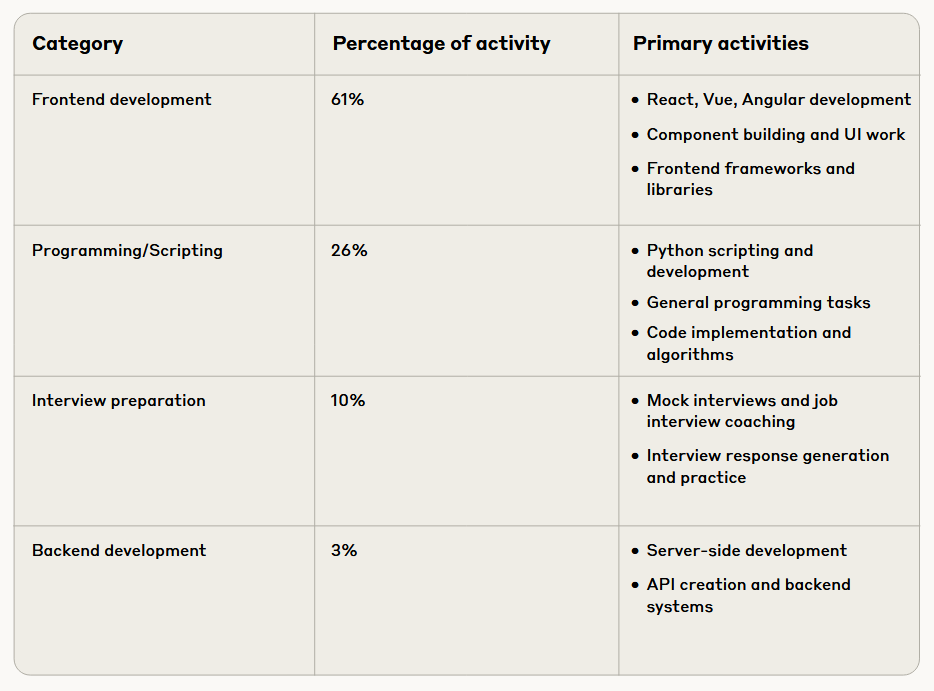

Anthropic a également découvert que des travailleurs informatiques nord-coréens ont utilisé Claude pour forger des identités convaincantes, réussir des tests techniques de codage et même décrocher des postes à distance dans des entreprises technologiques américaines du Fortune 500. Ils ont aussi utilisé Claude pour préparer des réponses aux entretiens pour ces postes.

Claude a également été utilisé pour effectuer le travail technique une fois embauché, a précisé Anthropic, notant que ces stratagèmes d’emploi visaient à canaliser les profits vers le régime nord-coréen malgré les sanctions internationales.

Répartition des tâches alimentées par Claude utilisées par les travailleurs informatiques nord-coréens. Source: Anthropic

Répartition des tâches alimentées par Claude utilisées par les travailleurs informatiques nord-coréens. Source: Anthropic Plus tôt ce mois-ci, un travailleur informatique nord-coréen a été contre-piraté, révélant qu’une équipe de six personnes partageait au moins 31 fausses identités, obtenant tout, des pièces d’identité gouvernementales et numéros de téléphone à l’achat de comptes LinkedIn et UpWork pour masquer leur véritable identité et décrocher des emplois dans la crypto.

L’un des travailleurs aurait passé un entretien pour un poste d’ingénieur full-stack chez Polygon Labs, tandis que d’autres preuves montraient des réponses d’entretien scriptées dans lesquelles ils affirmaient avoir de l’expérience chez le marché NFT OpenSea et le fournisseur d’oracle blockchain Chainlink.

Anthropic a déclaré que son nouveau rapport vise à discuter publiquement des incidents de mauvaise utilisation afin d’aider la communauté plus large de la sécurité et de la sûreté de l’IA et de renforcer la défense de l’industrie contre les abus de l’IA.

La société a indiqué que malgré la mise en œuvre de « mesures de sécurité et de sûreté sophistiquées » pour empêcher la mauvaise utilisation de Claude, les acteurs malveillants continuent de trouver des moyens de les contourner.

Avertissement : le contenu de cet article reflète uniquement le point de vue de l'auteur et ne représente en aucun cas la plateforme. Cet article n'est pas destiné à servir de référence pour prendre des décisions d'investissement.

Vous pourriez également aimer

En vogue

PlusChen Zhi du "Prince Group" aurait acheté une maison de luxe au Japon et fondé trois entreprises ; le prix des appartements de seconde main dans la résidence achetée est d'environ 10,33 millions de dollars.

Rapport de recherche : Analyse détaillée du projet Monad & analyse de la capitalisation de marché de MON