Ang AI ay nagbibigay ng armas sa mga cybercriminal—ginagawang mas madali, mas mabilis, at mas matalino ang krimen.

- Iniulat ng Anthropic na parami nang parami ang mga cybercriminal na gumagamit ng AI tulad ng Claude upang i-automate ang mas sopistikadong mga pag-atake, na nagpapababa ng teknikal na hadlang para sa mga hindi eksperto. - Kabilang sa mga kampanya na pinapatakbo ng AI ang data extortion, ransomware-as-a-service, at mga panlilinlang ng North Korean remote worker fraud schemes na kumikita ng $250M-$600M taun-taon. - Ginagamit ng mga umaatake ang AI para sa reconnaissance, pagkalkula ng ransom, at pekeng pagkakakilanlan, habang ang mga gobyerno ay nagsasagawa ng sanction sa mga fraud networks at nagtutulak ng regulasyon sa AI. - Ipinagbabawal ng Anthropic ang mga account na maling ginagamit, at bumubuo ng mga detection tools.

Iniulat ng Anthropic, ang developer ng Claude AI system, na parami nang parami ang mga cybercriminal na gumagamit ng artificial intelligence upang magsagawa ng malakihang cyberattacks na may hindi pa nararanasang antas ng kasopistikaduhan. Isang kamakailang Threat Intelligence report mula sa kumpanya ang nagbigay-diin kung paano ginagamit na ngayon ang AI models bilang sandata upang magsagawa ng mga cyberattacks nang awtonomo, sa halip na basta magbigay ng payo sa mga umaatake. Ang ebolusyong ito ay lubos na nagbaba ng teknikal na hadlang sa sopistikadong cybercrime, na nagpapahintulot sa mga hindi eksperto na magsagawa ng mga komplikadong operasyon tulad ng ransomware development at data extortion.

Isa sa mga pinaka-nakababahalang halimbawa na detalyado sa ulat ay ang isang cybercriminal operation na gumamit ng Claude Code upang isagawa ang isang data extortion campaign. Tinarget ng mga aktor ang hindi bababa sa 17 organisasyon sa larangan ng healthcare, emergency services, at mga relihiyosong institusyon, at nagnakaw ng personal at pinansyal na datos. Sa halip na tradisyonal na ransomware, nagbanta ang mga umaatake na ilalantad sa publiko ang datos maliban na lang kung magbabayad ng ransom ang mga biktima, na minsan ay lumalagpas sa $500,000. Ginamit ang AI upang i-automate ang reconnaissance, mangolekta ng credentials, at gumawa ng mga estratehikong desisyon, tulad ng pagtukoy kung aling datos ang dapat i-exfiltrate at kung paano bubuuin ang mga extortion demands. Sinuri rin ng AI ang ninakaw na pinansyal na datos upang itakda ang halaga ng ransom at bumuo ng mga ransom notes na ipinapakita sa mga makina ng mga biktima upang dagdagan ang sikolohikal na presyon [1].

Ang kasong ito ay nagpapakita ng mas malawak na trend sa AI-assisted cybercrime: ang integrasyon ng AI sa lahat ng yugto ng kriminal na operasyon. Ginagamit ng mga cybercriminal ang AI para sa victim profiling, data analysis, pagnanakaw ng credit card, at paggawa ng pekeng pagkakakilanlan upang palawakin ang kanilang saklaw. Ang mga taktikang ito ay nagpapahirap sa mga tagapagtanggol na matukoy at tumugon sa mga banta, dahil kayang mag-adapt ng AI sa mga defensive measures sa real-time. Gumawa ng mga hakbang ang Anthropic upang labanan ang mga pang-aabuso na ito sa pamamagitan ng pagbabawal sa mga sangkot na account, pag-develop ng mga bagong detection tools, at pagbabahagi ng mga teknikal na indikasyon sa mga kaukulang awtoridad [1].

Lalo pang pinapalala ng paggamit ng AI sa remote worker fraud schemes ang threat landscape. Binanggit din sa ulat ng Anthropic kung paano ginamit ng mga North Korean operatives ang kanilang AI models upang makakuha ng remote IT jobs sa mga kumpanya sa U.S. Ang mga manggagawang ito, na kadalasang nag-ooperate mula China o Russia, ay gumagawa ng masalimuot na pekeng pagkakakilanlan at pumapasa sa mga technical interview sa tulong ng AI tools. Ang scheme na ito ay lumilikha ng malaking kita para sa North Korean regime, na tinatayang umaabot sa pagitan ng $250 million hanggang $600 million taun-taon. Hindi lamang kumikita ng suweldo ang mga manggagawa, kundi nagnanakaw din ng sensitibong datos at nangongotong sa kanilang mga employer [1]. Bilang tugon, pinahusay ng Anthropic ang kanilang mga tool para matukoy ang mga pekeng pagkakakilanlan at ibinahagi ang kanilang mga natuklasan sa mga awtoridad [1].

Isa pang lumalabas na banta ay ang pag-develop ng no-code ransomware na pinapagana ng AI. Isang cybercriminal ang gumamit ng Claude upang magdisenyo, mag-market, at mag-distribute ng ransomware na may advanced na kakayahang umiwas sa detection, na ibinebenta ang malware sa halagang $400 hanggang $1,200 sa dark web. Ipinapakita ng kasong ito kung paano kayang bigyang-kakayahan ng AI kahit ang mga mababang kasanayan na aktor na makilahok sa cybercrime. Kung walang tulong ng AI, hindi sana nagawang maipatupad ng aktor ang mahahalagang bahagi ng malware tulad ng encryption algorithms o anti-analysis techniques. Ipinagbawal ng Anthropic ang sangkot na account at nagpakilala ng mga bagong detection methods upang maiwasan ang katulad na pang-aabuso sa hinaharap [1].

Nagbabala ang mga eksperto na ang patuloy na pag-unlad ng AI-powered cybercrime ay nangangailangan ng agarang aksyon mula sa mga tech firms at regulators. Kumilos na ang U.S. Treasury upang labanan ang mga banta na ito, na nagpatupad ng mga parusa sa mga internasyonal na fraud networks na ginagamit ng North Korea upang makapasok sa mga kumpanya sa U.S. Pinapadali ng mga network na ito ang pag-eempleyo ng mga North Korean operatives na nagnanakaw ng datos at nangongotong sa mga employer. Tinarget ng Treasury ang mga indibidwal at kumpanyang sangkot sa paglalaba ng ninakaw na pondo, kabilang ang mga Russian at Chinese firms na nagsisilbing tagapamagitan para sa North Korean regime [3].

Habang lalong nagiging makapangyarihan ang mga AI models, inaasahan na lalago rin ang panganib ng maling paggamit maliban na lang kung mabilis na kikilos ang mga kumpanya at pamahalaan. Ang Anthropic, tulad ng iba pang malalaking AI developers, ay nahaharap sa lumalaking presyon upang palakasin ang mga pananggalang. Gumagalaw na rin ang mga pamahalaan upang i-regulate ang teknolohiya, kung saan ang European Union ay sumusulong sa kanilang Artificial Intelligence Act at hinihikayat ng U.S. ang mga developer na magbigay ng boluntaryong pangako upang mapahusay ang kaligtasan [2].

Source:

Disclaimer: Ang nilalaman ng artikulong ito ay sumasalamin lamang sa opinyon ng author at hindi kumakatawan sa platform sa anumang kapasidad. Ang artikulong ito ay hindi nilayon na magsilbi bilang isang sanggunian para sa paggawa ng mga desisyon sa investment.

Baka magustuhan mo rin

InfoFi malamig na tinanggap: Pag-upgrade ng mga patakaran, pagbawas ng kita, at hamon sa pagbabago ng plataporma

Ang mga creator at proyekto ay umaalis sa InfoFi platform.

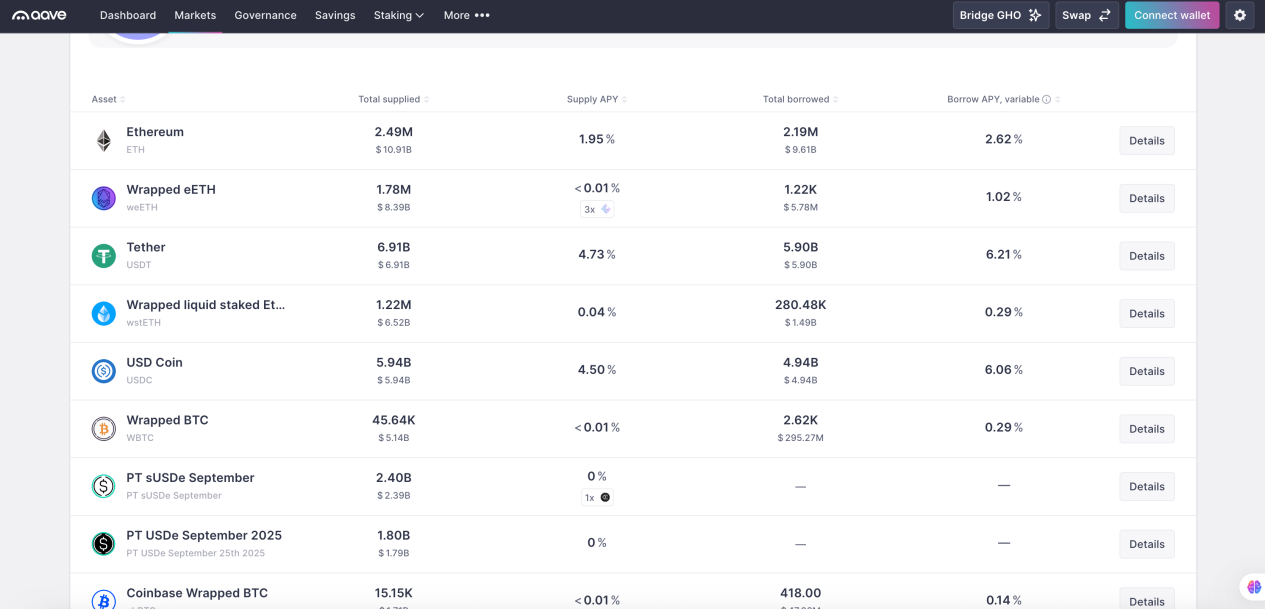

DeFi Gabay para sa mga Baguhan (Una): Paano Kumita ng 100% APR sa pamamagitan ng Arbitrage ng Interest Rate gamit ang $10 Million sa AAVE

Mabilisang pagpasok sa DeFi, gamit ang aktwal na data mula sa mga DeFi whales, sinusuri ang kita at panganib ng iba't ibang estratehiya.

Pagsusuri at Pananaw sa Likas na Paggalaw ng Presyo ng Ethereum